你的虚拟偶像,可能真的会出现在你家客厅

前几天,探长在日本体验了一场有点"超现实"的活动。

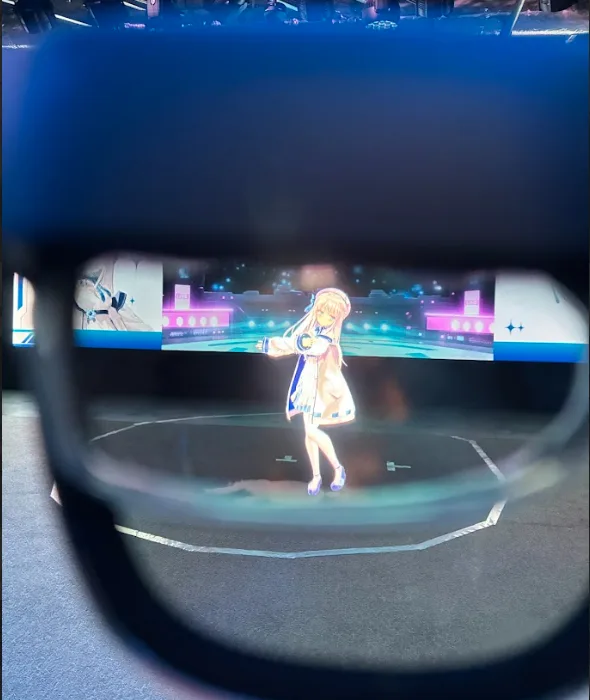

戴上一副AR眼镜,空荡荡的舞台上突然出现了凪乃ましろ(凪乃白)——等身大、立体、还能实时互动。不是录像,不是全息投影,就是那么"站"在那里。

这事儿发生在2026年3月17日,主办方是Mawari,技术合作方是KDDI。探长今天就来聊聊这场体验背后的技术逻辑,以及它可能带来的变化。

看起来就像真的

现场体验流程很简单:领一副XREAL Air 2 Ultra眼镜,戴上,看舞台。

然后凪乃ましろ就出现了。

不是那种劣质AR应用里会"飘"在空中的纸片人,而是稳稳站在地上,连脚下的阴影都对得上。你可以围着转圈看,从正面、侧面、背面——360度无死角。

探长在现场看到有人绕着虚拟偶像转了好几圈,有人疯狂拍照。凪乃ましろ和主持人聊游戏、聊日常,互动很自然,几乎感觉不到延迟。

说实话,这种"真实存在感"比探长预想的要强烈。不是因为画质有多好,而是因为细节处理到位——脚不会悬空,阴影有变化,动作流畅。这些看似不起眼的细节,恰恰是让虚拟角色"看起来像真的"的关键。

技术是怎么做到的?

两个关键词:5G毫米波和云渲染。

5G毫米波:给数据开了VIP通道

传统5G(Sub-6频段)虽然快,但大家一起用还是会抢带宽。传输超高清3D视频流,需要的是"独占通道"。

5G毫米波就是这种VIP通道。频段更高,带宽更宽,数据可以"独占"高速通道,不会因为别人用网多就卡顿。

但毫米波有个致命问题:怕挡。

频率越高,越走直线,绕障能力越差。一堵墙、一根柱子都能把信号拦下来。KDDI的解决方案是加中继器,现场部署了好几个,确保信号覆盖整个体验区。

云渲染:把算力搬到云端

传统AR需要在本地设备上做3D渲染,这对硬件要求很高。

这次用的是云渲染:3D模型、动画、渲染全在云端完成,处理好的视频流通过5G毫米波实时传到眼镜,眼镜只负责显示。

好处很明显:终端设备可以做得很轻便。一副AR眼镜就能实现原本需要高性能PC才能做到的效果。

这事儿能用来干嘛?

如果只是"看见偶像",这技术未免大材小用。

Mawari推出的ARAWA平台,想构建的是一套完整的MR内容生态:

- 虚拟偶像"巡演" —— 不需要场馆,VTuber可以"出现"在世界任何地方

- 限定MR视频 —— 粉丝购买只能在特定地点、特定时间观看的专属体验

- 本地化营销 —— 企业赞助虚拟偶像在特定地点"出现",做地域营销

本质上,这是在打破地理限制。

传统演唱会要考虑场地、物流、安保。虚拟偶像的AR巡演理论上可以同时在全球多个地点进行,每个地点的粉丝都觉得是"专属"体验。

还有一些问题

现场也暴露了一些问题:

- 设备准备时间长

- 偶尔会断连

- AR眼镜的视野角和分辨率还有提升空间

但这些都在快速解决。KDDI说会提供更多毫米波实验场地,AR硬件也在迭代。

探长觉得有意思的是对比:2025年2月彩虹社做过类似实验,用的是VR头显Quest 3。

这次用的是AR眼镜,更轻便,更适合长时间佩戴,但沉浸感和视觉质量不如VR。未来可能会这样分工:VR追求极致沉浸,AR追求便携舒适。

当虚拟和现实的边界模糊

凪乃ましろ在活动结束时说:"能够真正在同一空间中存在,我感到非常开心。"

这句话有点意思。对虚拟角色来说,这是第一次能以"物理在场"的方式和粉丝互动;对粉丝来说,这种体验带来的情感连接,远超隔着屏幕的互动。

探长忍不住想象了一些场景:

- 虚拟偶像在粉丝求婚现场"出现"

- 已故亲人的数字孪生在家庭聚会中"参与"

- 远程办公时,同事的虚拟形象"坐"在你旁边

这些场景以前只存在于科幻作品里,现在似乎越来越近了。

最后说两句

从文字、图片、音频、视频到VR/AR,我们一直在找更好的方式来"缩短"人与人之间的距离。

这次AR眼镜+5G毫米波+云渲染的组合,让我们离"随时随地和任何人(包括虚拟人)在一起"的未来,又近了一步。

如果你的虚拟偶像突然出现在你家客厅,你会做的第一件事是什么?

参考来源:

- MoguraVR现场报道

- Mawari官方新闻稿

- KDDI 5G毫米波技术说明